هوش مصنوعی (Artificial Intelligence) این روزها تبدیل به بخشی از زندگی روزمره شده و مدلهای زبانی بزرگ (Large Language Models یا LLM) مانند ChatGPT و کوپایلت، به ابزارهایی محبوب برای میلیونها کاربر بدل شدهاند. اما آیا تا به حال به این فکر کردهاید که این سیستمها چگونه میتوانند جملات معنادار بسازند و پاسخهای دقیق ارائه دهند؟ در این مقاله قصد داریم به زبان ساده نحوه عملکرد مدلهای زبانی بزرگ را توضیح دهیم و به مفاهیمی مانند بردارهای کلمه، ترنسفورمرها و پیشبینی کلمات بعدی بپردازیم.

بردارهای کلمه (Word Vectors)

مدلهای زبانی برای نمایش کلمات از اعداد استفاده میکنند. بهجای حروف و رشتههای متنی، هر کلمه به یک فهرست طولانی از اعداد تبدیل میشود که بردار کلمه نامیده میشود. به عنوان مثال، کلمه “گربه” ممکن است با برداری چند هزار بعدی نمایش داده شود که شباهتهای معنایی با کلمات مرتبط مانند “سگ” یا “حیوان خانگی” را نشان میدهد.

این رویکرد شبیه به مختصات جغرافیایی است. همانطور که میتوان فاصله بین شهرها را با اعداد مشخص کرد، مدلهای زبانی با بردارهای کلمه روابط بین مفاهیم را در فضای چندبعدی نمایش میدهند. این فضاها میتوانند صدها یا حتی هزاران بعد داشته باشند که امکان درک مفاهیم پیچیده و مشابهتها را فراهم میکنند.

استدلال برداری و قیاسها

بردارهای کلمات تنها برای نمایش معنا نیستند، بلکه امکان انجام استدلالهای ریاضی مانند قیاس را نیز فراهم میکنند. برای مثال، با محاسبه برداری خاص، میتوان دریافت که نسبت “پاریس به فرانسه” معادل “برلین به آلمان” است. این قابلیت باعث میشود مدلهای زبانی بتوانند روابط میان مفاهیم مختلف را یاد بگیرند و در پاسخها لحاظ کنند.

تبدیل بردارهای کلمه به پیشبینی کلمات

مدلهای زبانی بزرگ مانند GPT-3 و GPT-4 بر پایه شبکههای عصبی ساخته شدهاند و کلمات را بهصورت بردار دریافت میکنند. این بردارها در لایههای مختلف مدل پردازش میشوند تا بتوانند کلمه بعدی در جمله را پیشبینی کنند. هر لایه اطلاعات بیشتری در مورد زمینه و معنای کلمه فراهم میکند و بهتدریج مدل به درک بهتری از متن میرسد.

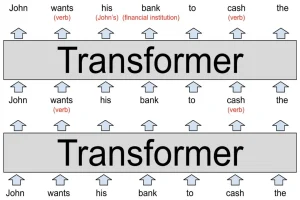

فرایند کار ترنسفورمرها

ترنسفورمرها ساختار اصلی مدلهای زبانی هستند و هر لایه آن از دو مرحله تشکیل میشود: توجه (Attention) و پیشخور (Feed-Forward). در مرحله توجه، هر کلمه با بررسی کلمات دیگر مرتبط با زمینه خود، اطلاعات لازم را جمعآوری میکند. سپس در مرحله پیشخور، این اطلاعات پردازش شده و کلمه بعدی پیشبینی میشود.

مکانیزم توجه (Attention Mechanism)

مکانیزم توجه شبیه سرویس همتاگزینی است. هر کلمه ویژگیهای خود را در بردار کلیدی و ویژگیهای کلمات مورد نظر را در بردار پرسوجو ذخیره میکند. مدل این دو بردار را مقایسه میکند و اطلاعات مرتبط را منتقل مینماید. این فرآیند باعث میشود که ضمایر، کلمات چندمعنایی و ترکیبات معنایی به درستی تفسیر شوند.

مکانیزم پیشخور (Feed-Forward)

در مرحله پیشخور، هر کلمه بهصورت مجزا پردازش میشود و مدل تلاش میکند بهترین پیشبینی را برای کلمه بعدی ارائه دهد. این مرحله با استفاده از محاسبات ریاضی و شبکههای عصبی، به اصلاح و بهبود پیشبینیها کمک میکند. در مدلهای بزرگ، میلیونها نورون و پارامتر برای تحلیل دادهها و یادگیری روابط بین کلمات استفاده میشوند.

نحوه آموزش مدلهای زبانی

مدلهای زبانی بزرگ با حجم عظیمی از دادههای متنی آموزش داده میشوند. هر متن به توکنهای کوچک تقسیم میشود و مدل با پیشبینی توکن بعدی در متن، توانایی تولید پاسخهای منطقی و مرتبط را کسب میکند. این آموزش، ضمن یادگیری زبان، روابط جهان واقعی و مفاهیم پیچیده را نیز بهصورت ضمنی درک میکند.

عملکرد شگفتانگیز مدلهای زبانی بزرگ

مدلهای زبانی میتوانند پاسخهای دقیق و خلاقانه ارائه دهند حتی اگر پیشتر با مثالهای مشابه مواجه نشده باشند. برای نمونه، GPT-4 قادر است بر اساس حجم زیادی از دادههای متنی، شکل و رفتار موجودات خیالی را نیز استنتاج کند. این توانایی به دلیل یادگیری روابط پیچیده میان مفاهیم و پیشبینی دقیق کلمات بعدی در متن ایجاد میشود.

در نهایت، عملکرد مدلهای زبانی بزرگ نه تنها به حجم داده و قدرت محاسباتی بستگی دارد، بلکه به نحوه نمایش مفاهیم و پردازش چندمرحلهای در ترنسفورمرها و شبکههای عصبی مرتبط است. این سیستمها نشان میدهند که با ابزارهای هوش مصنوعی میتوان درک عمیقی از زبان و ارتباطات انسانی ایجاد کرد.